Almawave - Velvet nella top 10 dei modelli AI fino a 20B parameter

Il sistema Made in Italy raggiunge un punteggio medio di 62.85. Un risultato che lo porta a surclassare aziende rinomate come IBM e Nvidia

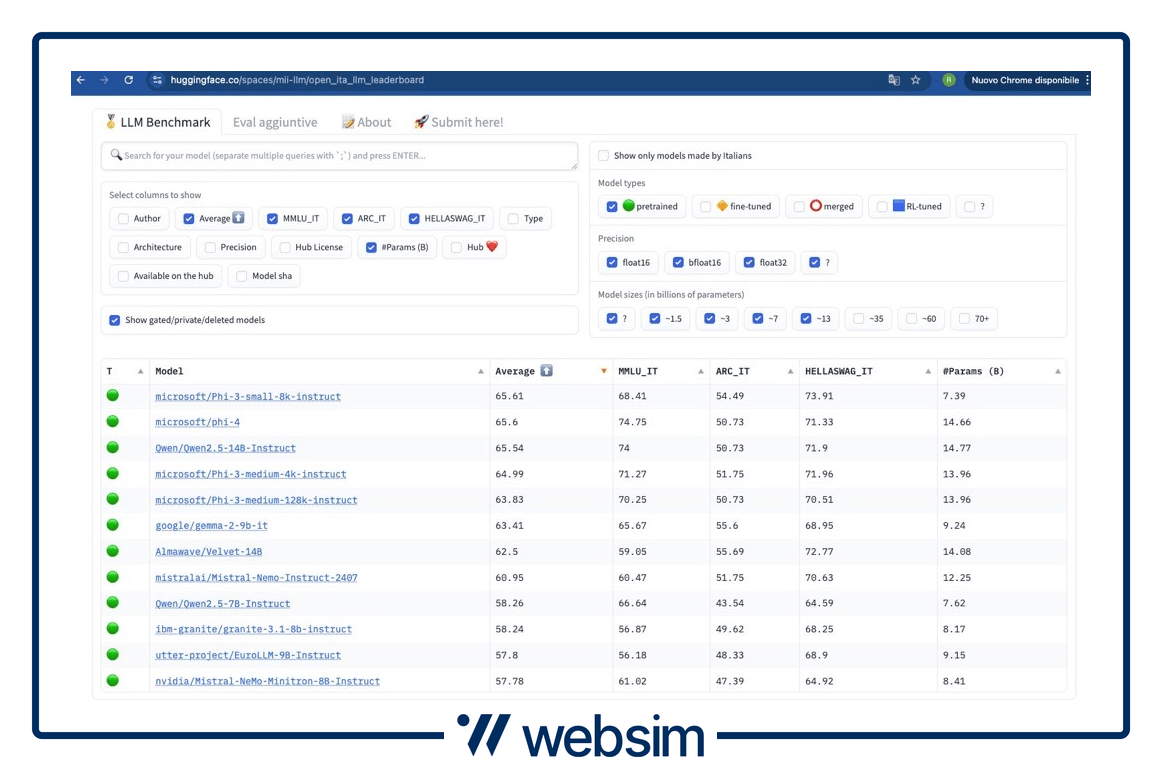

La classifica Open LLM Benchmark, pubblicata su Hugging Face, fornisce un'analisi delle prestazioni dei principali modelli di intelligenza artificiale generativa LLM (linguaggio di grandi dimensioni) open source e disponibili sul mercato in lingua italiana.

Scorrendo i vari nomi emerge che, relativamente ai modelli di dimensioni inferiori ai 20 miliardi di parametri, quelli di Microsoft dominano le prime posizioni, con Phi-3-small-8K-instruct (65.61 di punteggio medio) e Phi-4 (65.6) ai vertici. Anche Qwen (Qwen/Qwen2.5-14B-Instruct, 65.54) e Google (Gemma-2-9B-it, 63.41) si piazzano nella parte alta del ranking.

Tra i modelli più performanti spicca, al settimo posto, una realtà 100% Made in Italy: Velvet-14B della società Almawave, che raggiunge un punteggio medio di 62.85. Un risultato che porta il sistema tricolore a imporsi su aziende rinomate come IBM e Nvidia.

Le prestazioni di Velvet

Ecco un dettaglio delle sue prestazioni nelle diverse metriche, che verificano se un modello in italiano è bravo a rispondere a domande di cultura generale, a completare frasi in modo logico e a risolvere problemi di ragionamento.

- MMLU_IT: punteggio di 59.05. Massive Multitask Language: è una metrica di valutazione progettata per misurare le capacità di comprensione e risposta di un modello linguistico a domande di cultura generale.

- ARC_IT: punteggio di 55.69. Si tratta di una misura che valuta la capacità di ragionamento logico e scientifico di un LLM in italiano.

- HELLASWAG_IT: punteggio di 72.77. Questa sigla indica la valutazione della coerenza e della plausibilità del ragionamento.

- Numero di parametri: 14 miliardi.

“È il nostro primo modello AI di questa tipologia e siamo molto contenti dei risultati ottenuti e di essere già annoverati tra i leader internazionali sulle misure effettuate – ha fatto sapere Almawave – Abbiamo indirizzato il profilo del nostro modello su capabilities e funzionalità indicate per rispondere a casi d’uso aziendali, sulla base dell’esperienza fatta in 15 anni con clienti di diversi settori tra cui la pubblica amministrazione, la sanità, il welfare, la mobilità, il turismo, la giustizia, e altri”.

Le caratteristiche principali in sintesi

Il modello Velvet-14B mostra una performance particolarmente solida in HELLASWAG_IT, indicando una buona capacità di ragionamento e coerenza nella generazione di testi. Anche nei benchmark MMLU_IT e ARC_IT i punteggi sono competitivi, rendendolo una scelta valida per applicazioni avanzate in italiano.

Sarà interessante osservare come questo modello verrà adottato e sviluppato ulteriormente per migliorare le capacità di elaborazione della nostra lingua nel panorama dell'intelligenza artificiale. Va inoltre considerato il fatto che la maggior parte dei concorrenti presenti in classifica riguarda rilasci effettuati dopo la pubblicazione di altri svariati sistemi, mentre Almawave è all'inizio della sua corsa all'innovazione.

Il dettaglio della classifica

La classifica, in particolare, analizza e misura i modelli testuali open, disponibili sulla piattaforma Hugging Face, che gestiscono la lingua italiana. Nelle valutazioni sono inclusi i sistemi di dimensioni analoghe a quella di Velvet e addestrati “from scratch”, ovvero da zero, quindi senza partire da modelli esistenti e farne le fasi finali di “fine tuning”.

Azioni menzionate

Advertisement